Krótki obraz sytuacji: skąd nagle ten szał na NPU w laptopach

Dlaczego producenci mówią o „AI PC” i „Copilot+ PC”

Jeszcze niedawno przy wyborze laptopa liczyły się głównie trzy rzeczy: procesor, karta graficzna i bateria. Dziś na prezentacjach coraz częściej przewija się nowe hasło: AI PC, a w świecie Windows – konkretnie Copilot+ PC. W praktyce oznacza to jedno: w środku laptopa pojawił się dodatkowy układ, Neural Processing Unit (NPU), czyli wyspecjalizowany procesor do zadań związanych ze sztuczną inteligencją.

Marketing dorzuca do tego obietnice: szybsze generowanie obrazów, „asystent AI zawsze pod ręką”, lepszą baterię i prywatność, bo przetwarzanie ma się odbywać lokalnie, bez wysyłania danych w chmurę. Kluczowe pytanie brzmi jednak: czy użytkownik faktycznie coś z tego ma w codziennym korzystaniu z narzędzi AI offline, czy to tylko nowe logo na obudowie.

Producenci sprzętu i Microsoft pchają ten trend, bo modele AI urosły do takiej skali, że klasyczny CPU i GPU nie wystarczają, gdy chce się oferować funkcje „zawsze w tle”, które nie mogą drastycznie zjadać baterii. Stąd pomysł na osobny blok krzemowy wyłącznie do obliczeń sieci neuronowych – dokładnie tak, jak kiedyś osobny układ graficzny odciążył procesor z wyświetlania obrazu 3D.

Jaką rolę pełnią NPU obok CPU i GPU – prosty obraz

Dobrze działa prosty mentalny model:

- CPU – „mózg ogólny”: radzi sobie ze wszystkim, ale nie jest w niczym ekstremalnie wyspecjalizowany.

- GPU – „mięśnie od ciężkich zadań równoległych”: świetny do grafiki, renderingu, dużych obliczeń.

- NPU – „akcelerator odruchów AI”: robi bardzo konkretny typ zadań, ale za to szybko i energooszczędnie.

Dla sztucznej inteligencji kluczowe są operacje na macierzach i tensorach (duże „tablice” liczb). CPU potrafi to policzyć, GPU robi to szybciej dzięki tysiącom rdzeni równolegle, a NPU jest zaprojektowane pod konkretny schemat obliczeń typowy dla sieci neuronowych. To trochę jak różnica między zwykłym nożem kuchennym a krajalnicą do chleba: obu użyjesz do pokrojenia bochenka, ale tylko jedna zrobi to szybko, równo i bez wysiłku.

W praktyce Windows wykorzystuje NPU do rzeczy, które dzieją się „po cichu”, np. rozpoznawanie mowy, filtrowanie tła w wideo, analiza obrazu kamery. Z punktu widzenia użytkownika ważne jest, że te funkcje mogą działać stale i nie „gotują” laptopa, bo zamiast procesora lub karty graficznej pracuje energooszczędny NPU.

Co się zmieniło w ciągu ostatnich 2–3 lat

W ciągu ostatnich kilku lat zaszły trzy równoległe zmiany:

Po pierwsze, modele AI dramatycznie urosły. Gdyś proste sieci rozpoznawały twarze czy litery. Teraz lokalne modele językowe czy wizualne potrafią pisać teksty, tłumaczyć, podsumowywać dokumenty, opisywać obrazy. Nawet „małe” modele, które da się uruchomić na laptopie, liczą parę miliardów parametrów, co generuje ogrom pracy obliczeniowej.

Po drugie, rosną oczekiwania, że AI będzie działać offline. Użytkownicy chcą transkrypcji spotkań, tłumaczeń, prostych chatbotów czy rozpoznawania obrazu bez zależności od internetu, bez wysyłania nagrań i dokumentów do chmury. To dużo bardziej wrażliwe dane niż zwykłe korzystanie z przeglądarki.

Po trzecie, laptopy stały się faktycznie mobilnym centrum pracy. Coraz częściej cały dzień spędza się na baterii: kilka spotkań wideo, montaż krótkich klipów, notatki. Gdyby każda funkcja AI była liczona na CPU lub GPU, bateria kończyłaby się dramatycznie szybko, a wentylatory kręciły pełną parą. NPU ma temu przeciwdziałać: zapewnić „stałe AI” bez dramatycznego wzrostu poboru energii.

Jakie obietnice składają producenci sprzętu

Hasła marketingowe wokół NPU przewijają się w kółko, ale można je sprowadzić do kilku konkretnych obietnic:

- Dłuższy czas pracy na baterii przy aktywnych funkcjach AI – czyli wideokonferencje z rozmytym tłem i redukcją szumów, lokalna transkrypcja, tłumaczenia „na żywo” bez drenażu akumulatora.

- Prywatność i przetwarzanie na urządzeniu – dane z mikrofonu, kamery czy dokumentów mają być analizowane lokalnie, bez konieczności wysyłania ich do serwerów.

- Niskie opóźnienia – AI ma reagować natychmiast, bez czekania na odpowiedź z chmury, np. przy sterowaniu głosem lub filtrach wideo.

- Nowe funkcje systemowe, takie jak Recall czy zaawansowane napisy na żywo, które w zamierzeniu po prostu dzieją się w tle i są „zawsze gotowe”.

Część z tych obietnic już dzisiaj jest realna, ale bardzo zależy od konkretnego modelu laptopa, wersji Windows i tego, czy używane aplikacje faktycznie korzystają z NPU, a nie tylko z CPU/GPU. Samo logo „AI PC” nie wystarcza – potrzebne są dobrze zaimplementowane narzędzia AI offline, które ten układ potrafią użyć.

Co to właściwie jest NPU: proste wyjaśnienie bez marketingu

Neural Processing Unit – po co powstał taki układ

NPU (Neural Processing Unit) to wyspecjalizowany procesor zaprojektowany do wykonywania operacji typowych dla sieci neuronowych: mnożenia dużych macierzy, obliczeń na tensorach i prostych funkcji nieliniowych (jak ReLU, Sigmoid itd.). Zamiast uniwersalności, liczy się tu powtarzalny, masowo równoległy schemat obliczeń.

Idea jest prosta: skoro algorytmy AI wykonują w kółko ten sam typ operacji, to lepiej zbudować układ, który robi tylko to, ale za to ekstremalnie szybko i z minimalnym zużyciem energii. To podobny kierunek jak w przypadku układów DSP (Digital Signal Processor) w telefonach – one też liczą „w kółko to samo”, np. przetwarzanie dźwięku, ale robią to bardzo wydajnie.

NPU w laptopach z Windows można znaleźć m.in. w procesorach Intel Core Ultra (Meteor Lake), AMD Ryzen z blokiem Ryzen AI czy w układach Qualcomm Snapdragon X. Z zewnątrz widać tylko jedną nazwę procesora, ale wewnątrz znajduje się osobny blok obliczeniowy, zwykle z dedykowaną pamięcią i zestawem instrukcji.

Czym NPU różni się od GPU w praktyce

GPU (Graphics Processing Unit) również świetnie radzi sobie z obliczeniami na macierzach i tensorach, dlatego od lat jest wykorzystywane do trenowania i uruchamiania modeli AI. Różnica pojawia się w kilku punktach:

- Zakres zastosowań – GPU musi jednocześnie obsługiwać grafikę 2D/3D, wideo, czasem fizykę w grach i zadania AI; NPU jest zbudowane wyłącznie pod sztuczną inteligencję.

- Moc szczytowa vs efektywność – GPU potrafi mieć ogromną moc obliczeniową, ale przy bardzo wysokim poborze energii; NPU ma mniejszą moc szczytową, lecz przy minimalnym zużyciu energii i niskiej emisji ciepła.

- Integracja z systemem – w laptopach Windows NPU jest silniej „wpięte” w systemowy stos AI (Windows ML, ONNX Runtime, DirectML), więc do prostych zadań AI w tle system chętnie sięga właśnie po ten układ.

W efekcie GPU nadal króluje przy ciężkich zadaniach typu generowanie złożonych grafik, duże modele językowe czy rendering wideo, ale do ciągłych, lekkich obliczeń „na bieżąco” NPU jest znacznie bardziej opłacalne. To rozróżnienie jest kluczowe przy ocenie, na ile nowe NPU faktycznie pomogą konkretnym narzędziom AI offline.

Na czym polega przetwarzanie tensora i po co do tego osobny układ

Wyobraź sobie, że masz zdjęcie z kamery internetowej o rozdzielczości 1920×1080 pikseli. Dla sieci neuronowej to nie jest „obraz”, tylko ogromna tablica liczb: intensywności kolorów każdego piksela. Podobnie tekst, zanim trafi do modelu językowego, zamienia się na wektory liczb reprezentujące słowa lub części słów.

Te liczby tworzą właśnie tensory – wielowymiarowe tablice danych. Model AI składa się z wielu warstw, które wykonują operacje matematyczne na tych tensorach: głównie mnożenie i dodawanie macierzy oraz proste funkcje aktywacji. Te operacje są bardzo powtarzalne i mocno równoległe: można je wykonywać jednocześnie na tysiącach lub milionach elementów.

CPU liczy to sekwencyjnie i dość ogólnie, GPU równolegle na wielu rdzeniach, a NPU dodatkowo ma sprzętowo zoptymalizowane jednostki do konkretnych typów operacji, z minimalnym „narzutem” sterującym. Dzięki temu, gdy ta sama sieć neuronowa jest uruchomiona na NPU i GPU, NPU bywa wolniejsze od GPU w surowej mocy, ale:

- zużywa wyraźnie mniej energii,

- mniej grzeje laptopa,

- nie obciąża pamięci graficznej potrzebnej np. do gier czy renderingu.

Dlaczego NPU zużywa mniej energii na to samo zadanie

Energooszczędność NPU wynika z kilku czynników konstrukcyjnych:

- Wysłpecjalizowane jednostki obliczeniowe – układ nie musi obsługiwać pełnego zestawu instrukcji jak CPU czy GPU, tylko wąski zakres operacji, więc struktura jest prostsza i bardziej upakowana.

- Lepsza lokalność pamięci – dane są przechowywane bliżej jednostek obliczeniowych, często w dedykowanych buforach, co zmniejsza konieczność korzystania z dalekiej pamięci RAM.

- Niższe taktowanie przy dużej równoległości – wiele operacji jest wykonywanych równocześnie przy stosunkowo niskich częstotliwościach, co jest dużo bardziej energooszczędne.

Efekt z perspektywy użytkownika? Możliwość uruchomienia stałych, „podsłuchujących” funkcji AI offline (np. nasłuchiwanie słowa kluczowego, ciągła analiza wideo) bez zauważalnego skrócenia czasu pracy na baterii. CPU czy GPU też by to policzyły, ale przy nieporównywalnie większym poborze mocy. Właśnie tu zaczynają się realne korzyści NPU dla narzędzi AI działających lokalnie.

Przegląd aktualnych NPU w laptopach z Windowsem

Najważniejsze platformy: Snapdragon X, Intel Core Ultra, AMD Ryzen AI

Rynek NPU w laptopach z Windows jest dziś skupiony wokół trzech głównych platform:

- Qualcomm Snapdragon X (Elite/Plus) – układy ARM projektowane specjalnie z myślą o Copilot+ PC, z bardzo mocnym, zintegrowanym NPU i naciskiem na energooszczędność.

- Intel Core Ultra (Meteor Lake i nowsze) – procesory x86 z wbudowanym blokiem AI w pakiecie (tzw. AI Boost), które łączą tradycyjne rdzenie CPU, zintegrowane GPU i NPU.

- AMD Ryzen z Ryzen AI – procesory z rodziny Ryzen 7000/8000/9000 z dedykowanym akceleratorem sztucznej inteligencji, stopniowo rozszerzane w kolejnych generacjach.

Każda z tych platform podkreśla liczbę TOPS (Tera Operations Per Second) jako wskaźnik „mocy AI”. Warto jednak traktować te liczby ostrożnie – są one liczone w różnych warunkach i nie zawsze przekładają się liniowo na wydajność w rzeczywistych zadaniach.

TOPS – co to jest i jak to czytać „po ludzku”

TOPS oznacza liczbę bilionów (1012) operacji na sekundę. Producenci podają osobno TOPS dla CPU, GPU i NPU, a czasem zbiorczo dla całego układu. Im wyższa liczba, tym większa potencjalna moc obliczeniowa.

Problem polega na tym, że:

- różne firmy liczą TOPS w różnych precyzjach (np. INT8, INT4, FP16),

- nie zawsze wiadomo, przy jakim poborze energii uzyskiwana jest ta wartość,

- same TOPS nie mówią nic o szybkości konkretnej aplikacji, która może być ograniczona np. przepustowością pamięci.

Mimo to da się wyciągnąć kilka prostych wniosków praktycznych:

- NPU z niższymi wartościami TOPS (np. pierwsze generacje Intel Core Ultra, starsze Ryzen AI) dobrze radzą sobie z filtrami wideo, rozpoznawaniem mowy czy prostymi modelami językowymi.

- Mocniejsze NPU (np. w Snapdragon X) umożliwiają płynne działanie bardziej zaawansowanych modeli – transkrypcji na żywo, szybszego generowania obrazów, rozbudowanych funkcji Copilot+.

Dlaczego „50 TOPS w NPU” to nie to samo co „50 TOPS w GPU”

Przy porównywaniu specyfikacji łatwo ulec złudzeniu, że ta sama liczba TOPS oznacza taki sam poziom wydajności niezależnie od układu. W praktyce NPU i GPU osiągają deklarowane TOPS w zupełnie innych warunkach i do innych typów obciążeń.

NPU jest projektowane z założeniem, że dany model AI będzie wykonywał ten sam graf obliczeń przez dłuższy czas – np. wciąż ten sam model transkrypcji mowy czy ten sam filtr wideo. Dzięki temu producenci mogą „twardo” zoptymalizować ścieżki danych, bufory, kolejki. GPU natomiast musi być gotowe na rendering gry, obróbkę wideo, a dopiero w międzyczasie na sieci neuronowe.

Jedno z praktycznych następstw: NPU bardzo dobrze skaluje się przy stałych, powtarzalnych zadaniach, ale gorzej znosi częste zmiany modeli i parametrów. Jeśli aplikacja co chwilę ładuje inny model lub dynamicznie go modyfikuje, część potencjału TOPS po prostu się marnuje na przełączanie kontekstu, kopiowanie parametrów i przygotowanie grafu.

Z punktu widzenia narzędzi AI offline oznacza to, że:

- funkcje typu „cały czas nasłuchuję mikrofonu, ale rzadko coś liczę” wcale nie muszą najlepiej działać na NPU – bywa, że wygodniej i szybciej obsłuży je lekkie GPU lub CPU,

- stałe, długotrwałe zadania (ciągła analiza wideo, rozbudowane filtry) najlepiej „wpadają” na NPU, o ile aplikacja potrafi utrzymać model w jego pamięci i nie żongluje nim zbyt często.

Jak Windows faktycznie wykorzystuje NPU już dziś

Systemowe API: Windows ML, ONNX Runtime, DirectML

Aby NPU nie było tylko „ukrytym bloczkiem” w środku procesora, Microsoft udostępnia programistom kilka warstw oprogramowania, które potrafią skierować obliczenia na właściwy układ:

- Windows ML – starsze, ale wciąż obecne API do uruchamiania modeli ONNX w aplikacjach UWP i niektórych programach desktopowych.

- ONNX Runtime – bibliotekę uruchomieniową do modeli w formacie ONNX. Ma tzw. execution providers, które potrafią korzystać z DirectML, CUDA, czy właśnie NPU (przez sterowniki producentów).

- DirectML – warstwę obliczeniową na bazie DirectX, która pozwala akcelerować modele AI na różnych układach (GPU, w coraz większym stopniu także NPU) z jednolitym interfejsem.

Dla użytkownika ma to prosty efekt uboczny: ta sama aplikacja może bez zmian w interfejsie nagle przyspieszyć, gdy uruchomi się na laptopie z NPU i aktualnym Windowsem, bo biblioteka „pod spodem” wybierze szybszą ścieżkę wykonania.

Copilot+ PC i funkcje systemowe oparte o NPU

W nowych laptopach klasy Copilot+ PC Microsoft agresywnie promuje funkcje, które z założenia mają działać lokalnie i opierać się o NPU. Do najbardziej widocznych należą:

- Studia efektów kamery – rozmywanie tła, korekcja kadru (auto-framing), utrzymywanie „kontaktu wzrokowego”, które w nowszych wersjach Windows mogą być liczone na NPU zamiast na GPU.

- Zaawansowana redukcja szumów i poprawa głosu – filtracja tła, podbicie wyraźności mowy, czasem także „czyszczenie” nagrań w czasie rzeczywistym podczas rozmów wideo.

- Pierwsze wersje lokalnych modeli językowych – np. elementy Copilot działające w trybie local-first, które w wybranych konfiguracjach wstępnie uruchamiają niewielkie modele w pamięci lokalnej.

Znaczenie ma tu konfiguracja sprzętu. Na słabszych NPU część zadań i tak wyląduje na GPU, a Windows stara się tylko rozkładać obciążenie tak, żeby nie „zabić” baterii. Na mocniejszych Snapdragonach X więcej z tych funkcji może być liczone wyłącznie na NPU, dzięki czemu laptop podczas wideokonferencji pozostaje chłodniejszy i cichszy.

Integracja z aplikacjami: Teams, Office, przeglądarki

Coraz więcej popularnych programów potrafi już korzystać z NPU przez systemowe API. Dla przykładu:

- Microsoft Teams – rozmywanie tła, auto-kadr, redukcja szumów; część z tych funkcji potrafi zejść z GPU na NPU, jeśli jest dostępny.

- Office / Microsoft 365 – moduły rozpoznawania mowy i dyktowania, niektóre funkcje korekty stylistycznej i podpowiedzi mogą być wspierane lokalnie przez modele działające na NPU (choć wiele z nich nadal opiera się o chmurę).

- Przeglądarki – eksperymentalne funkcje typu lokalne modele tłumaczenia stron czy rozpoznawania mowy w Edge/Chromium mogą korzystać z NPU, jeśli użyty jest ONNX Runtime lub WebNN z odpowiednim backendem.

Z perspektywy użytkownika całość jest w dużej mierze przezroczysta. Jedyny ślad, że pracuje NPU, to niższe zużycie energii lub mniejsze „skoki” użycia GPU w Menedżerze zadań podczas rozmowy czy transkrypcji.

NPU kontra CPU i GPU: kiedy co ma sens przy AI offline

Profil obciążenia: krótko, intensywnie vs długo, spokojnie

Przybliżony podział ról można sprowadzić do prostego rozróżnienia:

- CPU – dobre do krótkich, nieregularnych zadań, wielu małych modeli, logiki aplikacji, przygotowania danych.

- GPU – najlepsze do ciężkich, intensywnych obliczeń na dużych modelach, kiedy nie martwisz się aż tak baterią.

- NPU – stworzone do długotrwałych, powtarzalnych zadań AI „w tle”, które nie mogą zjadać całego budżetu energetycznego.

Przykład praktyczny: jeśli raz na jakiś czas uruchamiasz duży model obrazu (np. generowanie grafiki 1024×1024 w wysokiej jakości), GPU dalej będzie szybszym wyborem. Jeśli jednak chcesz czas mieć włączony filtr redukcji szumów na mikrofonie i podgląd kamery z rozmytym tłem, NPU zapewni to przy znacznie niższym zużyciu energii.

Kiedy CPU wciąż wygrywa z NPU

Przy całym szumie wokół NPU łatwo przeoczyć, że w wielu zastosowaniach zwykły CPU nadal jest najbardziej sensownym wyborem:

- gdy modele są bardzo małe i uruchamiane sporadycznie (np. krótkie klasyfikatory tekstu, proste detektory),

- kiedy aplikacja nie jest jeszcze napisana z użyciem ONNX Runtime czy DirectML i nie potrafi wysłać zadań na NPU,

- w sytuacjach, gdzie „koszt” kopiowania danych do/pomiędzy akceleratorami zjada zysk z przyspieszenia.

Przy jednorazowych zadaniach typu „przeanalizuj ten jeden plik PDF lokalnym modelem” CPU bywa wystarczająco szybkie, a udział NPU dałby zaledwie symboliczne zyski. Prawdziwe korzyści pojawiają się dopiero, gdy obciążenie staje się stałe lub powtarzalne.

GPU jako „ciężka artyleria” dla lokalnych modeli

Jeżeli w laptopie jest porządne GPU (mobilne RTX, Radeon, mocne iGPU), to do lokalnego generowania obrazów lub uruchamiania większych LLM wciąż jest to główny koń pociągowy. Powód jest prosty: przepustowość pamięci i liczba jednostek obliczeniowych.

Nawet mocne NPU w dzisiejszych laptopach często mają:

- ograniczoną ilość lokalnej pamięci,

- gorszą obsługę modeli o bardzo złożonej strukturze,

- mniej dojrzały ekosystem narzędzi (profilery, debuggery, biblioteki).

Dlatego typowy scenariusz „domowego laboratorium AI” wygląda dziś tak, że trening i duże inferencje odbywają się na GPU, a NPU jest wykorzystywane do lżejszych, ale stałych zadań wspierających – np. do wstępnego przetwarzania dźwięku, vision czy prostych asystentów.

Hybrydowe podejście: współpraca CPU, GPU i NPU

Coraz więcej bibliotek próbuje rozkładać zadania AI między różne układy:

- część warstw modelu można policzyć na GPU (np. te najbardziej „ciężkie” macierzowo),

- inne – szczególnie prostsze lub powtarzalne – na NPU,

- CPU zajmuje się przygotowaniem danych, tokenizacją, kolejkami zadań.

Taki podział wciąż jest we wczesnej fazie rozwoju i nie zawsze działa bezproblemowo, ale kierunek jest jasny: narzędzia AI offline na Windows będą starały się „wycisnąć” wszystkie trzy układy naraz. Dla użytkownika będzie to widoczne głównie jako płynniejsze działanie bez drastycznego skracania czasu pracy na baterii.

Jakie narzędzia AI offline realnie korzystają dziś z NPU w Windows

Transkrypcja i rozpoznawanie mowy

Jednym z pierwszych realnych zastosowań NPU w laptopach jest lokalna transkrypcja mowy – zarówno w systemowych funkcjach dyktowania, jak i w aplikacjach firm trzecich.

Scenariusz wygląda prosto: nagrywasz spotkanie w Teams, Zoomie lub innym komunikatorze, a w tle system lub dodatkowa aplikacja przetwarza dźwięk na tekst. Jeśli laptop ma NPU i aktualny stos oprogramowania, model rozpoznawania mowy może działać w całości lokalnie, bez wysyłania nagrań do chmury.

Zysk: większa prywatność, mniejsza zależność od jakości połączenia i stabilniejsze działanie – NPU zapewnia stałą, przewidywalną wydajność przy małym zapotrzebowaniu na energię. Przy długich spotkaniach różnica w nagrzewaniu i zużyciu baterii między CPU/GPU a NPU bywa już zauważalna.

Filtry wideo i „upiększanie” obrazu z kamery

Druga duża kategoria to przetwarzanie obrazu z kamery w czasie rzeczywistym. Chodzi o wszystkie efekty, które do tej pory zwykle były realizowane przez GPU:

- rozmycie lub wymiana tła,

- śledzenie twarzy i auto-kadr,

- „kontakt wzrokowy” – korekta spojrzenia w stronę obiektywu,

- upłynnianie obrazu, poprawa ostrości i ekspozycji z użyciem sieci neuronowych.

Nowe wersje tych funkcji w Windows i aplikacjach wideokonferencyjnych potrafią uruchamiać swoje modele na NPU. Dla osoby po drugiej stronie nie ma różnicy – obraz wygląda podobnie lub nieco lepiej. Dla użytkownika laptop działa jednak ciszej, nie rozkręca wentylatorów przy każdym włączeniu kamery i potrafi dłużej wytrzymać na baterii, szczególnie przy kilku długich spotkaniach pod rząd.

Redukcja szumów i przetwarzanie dźwięku

Wiele współczesnych algorytmów redukcji szumów, „odszumiających” mikrofon lub nagranie, bazuje na głębokich sieciach neuronowych. To naturalne zadanie dla NPU, bo:

- strumień danych (dźwięk) jest ciągły i dobrze przewidywalny,

- modele są średniej wielkości, ale wymagają stałej pracy,

- użytkownik oczekuje braku opóźnień i stabilności, nawet podczas pracy na baterii.

Na laptopach z NPU można mieć cały czas włączoną „inteligentną” redukcję szumów, która odcina odgłosy klawiatury, klimatyzacji czy ulicy, a mimo to nie powoduje nagłego spadku czasu pracy na baterii. To jeden z tych przykładów, gdzie przesiadka na NPU daje od razu odczuwalną korzyść, nawet jeśli użytkownik nigdy nie interesował się specyfikacją sprzętu.

Proste asystenty i narzędzia kontekstowe

Na rynku pojawiają się też lekkie asystenty działające offline, które potrafią:

- streszczać zawartość okna (np. dokumentu, strony WWW),

- podpowiadać odpowiedzi w mailach na bazie lokalnego kontekstu,

- wyszukiwać informacje w lokalnych plikach bez wysyłania danych do chmury.

W wielu przypadkach używają one niewielkich modeli językowych i modeli klasyfikujących uruchamianych przez ONNX Runtime. Jeśli sprzęt i sterowniki na to pozwalają, obliczenia mogą trafić na NPU zamiast na CPU. W efekcie taki asystent może „czaić się” w tle praktycznie cały dzień, reagując na skrót klawiszowy i wywołując lokalny model, nie drenując przy tym baterii.

Specjalistyczne zastosowania: medycyna, przemysł, badania

Poza typowym zastosowaniem biurowym i domowym pojawiają się też wąsko wyspecjalizowane narzędzia, które zaczynają wykorzystywać NPU:

- oprogramowanie medyczne do wstępnej analizy obrazów (np. zdjęć RTG) w trybie offline, gdy nie można lub nie wolno wysyłać danych do chmury,

- aplikacje przemysłowe do detekcji anomalii na nagraniach z kamer kontrolnych, działające bez stałego dostępu do sieci,

Przetwarzanie obrazu i wideo offline

W segmencie kreatywnym pojawiają się pierwsze narzędzia, które część zadań przerzucają na NPU. Chodzi głównie o stałe, powtarzalne operacje na obrazie, które trudno nazwać „efektem WOW”, ale są używane cały czas.

Przykładowo, w edytorach zdjęć i wideo:

- segmentacja obrazu (oddzielanie tła od obiektu),

- wstępne wykrywanie scen lub twarzy w klipach,

- korekcja ekspozycji i szumów sterowana przez sieci neuronowe

może być wykonywana właśnie na NPU. GPU nadal zostaje dla renderingu podglądu i finalnego eksportu, ale „żmudne” analizy per-klatka/piksel mogą lecieć przez NPU, co odciąża resztę systemu. Widać to szczególnie na słabszych ultrabookach, gdzie do tej pory przy takim obciążeniu wszystko potrafiło „chrupnąć”.

Aplikacje bezpieczeństwa i prywatności

Drugi ciekawy kierunek to lokalne systemy ochrony – od prostych „strażników kamery” po bardziej zaawansowane rozwiązania korporacyjne. Zamiast streamować obraz lub dźwięk do chmurowej analizy, niewielkie modele działają bezpośrednio na NPU:

- proste wykrywanie ruchu i osób w kadrze,

- lokalne rozpoznawanie określonych dźwięków (np. alarmu, szkła, krzyku),

- klasyfikacja aktywności – czy ktoś faktycznie jest przy komputerze, czy tylko rusza się roślina w tle.

Dla użytkownika domowego może to być aplikacja, która wybudza się tylko wtedy, gdy „coś” dzieje się przed kamerą laptopa. W firmach – mechanizm, który pilnuje zgodności z polityką bezpieczeństwa (np. wykrywa, że na ekranie pojawiły się wrażliwe dane i wymusza dodatkowe zabezpieczenia), a wszystko to działa lokalnie, bez wysyłania surowego obrazu na zewnątrz.

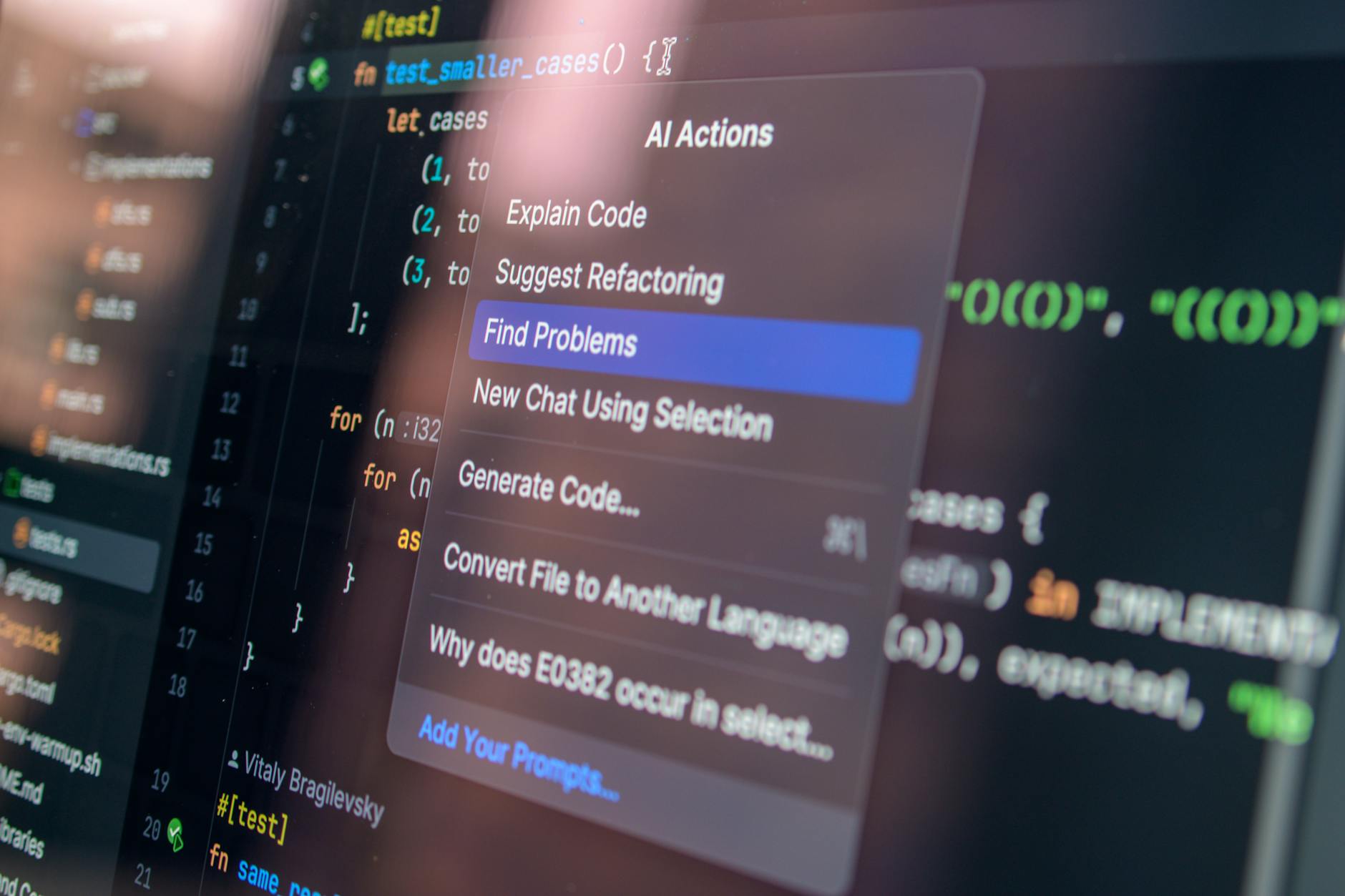

Narzędzia deweloperskie i testowe

Programiści dostają stopniowo SDK i zestawy narzędzi, które pozwalają im na własną rękę eksperymentować z NPU:

- ONNX Runtime z wsparciem dla DirectML i rozszerzeń NPU,

- wtyczki do popularnych frameworków (PyTorch, TensorFlow) eksportujące modele do ONNX i dalej na NPU,

- profile i logi w narzędziach pokroju Visual Studio / PerfView pokazujące, które operacje lądują na akceleratorze.

Pierwsza fala to zwykle po cichu przyspieszone funkcje: inteligentne wyszukiwanie w IDE, podpowiedzi kodu częściowo działające lokalnie, analiza logów czy prosty scoring modeli bez łączenia się z serwerem. Duże asystenty programistyczne wciąż siedzą głównie w chmurze, ale to, co można bez bólu przenieść lokalnie, zaczyna korzystać z NPU jako „silnika pomocniczego”.

Modele językowe i generatywne offline – co jest możliwe na NPU tu i teraz

Wielkość modeli a możliwości dzisiejszych NPU

Intuicyjna zasada jest taka: im mniejszy model, tym większa szansa, że sensownie zadziała na NPU. Dzisiejsze układy w laptopach radzą sobie tak naprawdę z:

- mikro‑LLM – modele rzędu kilkuset milionów parametrów do ~2–3 miliardów parametrów, mocno skompresowane,

- modelami specjalistycznymi – klasyfikatory, ekstraktory informacji, detektory intencji (tzw. NLU),

- sieciami generującymi krótkie odpowiedzi tekstowe lub proste podsumowania.

Konstrukcje pokroju „GPT‑4 w całości na NPU w ultrabooku” są jeszcze poza zasięgiem. Za to mały model, który rozumie kontekst okna, potrafi napisać szkic odpowiedzi na maila lub streścić otwarty artykuł – jest już jak najbardziej realistyczny, szczególnie przy zastosowaniu technik typu kwantyzacja (obniżanie precyzji liczb, np. do 4–8 bitów).

Jakość odpowiedzi: na co się nastawiać

W porównaniu z dużymi modelami w chmurze, lokalne modele na NPU są skromniejsze językowo. Dobrze radzą sobie z:

- krótkimi podsumowaniami fragmentów tekstu,

- wyciąganiem kluczowych informacji (np. dat, nazw, liczb),

- klasyfikacją – ton wypowiedzi, kategorie tematów, „to jest / nie jest spamem”,

- prostą reformulacją – „napisz to bardziej formalnie”, „skrót w trzech punktach”.

Gorzej idzie tam, gdzie potrzeba szerokiej wiedzy ogólnej, rozumienia kontekstu z wielu źródeł naraz albo wieloetapowego rozumowania. Tu w praktyce kończy się na hybrydzie: mały model offline robi wstępną robotę (np. oczyszcza i streszcza tekst), a dopiero potem większy model w chmurze dostaje „skondensowaną” wersję, co oszczędza transfer danych i poprawia prywatność.

Modele lokalne w stylu „asystent komputera”

Naturalny obszar zastosowań lokalnych LLM‑ów na NPU to rola asystenta systemowego. Zamiast robić encyklopedię świata, mały model skupia się na:

- rozumieniu tego, co jest aktualnie na ekranie (okna, tytuły, fragmenty tekstu),

- interpretowaniu krótkich poleceń użytkownika („znajdź w tym PDF-ie warunki gwarancji”),

- układaniu konkretnych, krótkich odpowiedzi w oparciu o zawartość lokalnych dokumentów.

NPU jest tu potrzebne głównie po to, by taki model mógł być niemal cały czas w gotowości. CPU poradziłoby sobie z jednym wywołaniem, ale permanentne nasłuchiwanie i analiza kontekstu w tle zabiłyby czas pracy na baterii. NPU pozwala zostawić ten proces „pod prądem” przy znikomym poborze energii, trochę jak specjalizowany koprocesor od obsługi klawiatury czy czytnika linii papilarnych.

Generowanie obrazów offline na NPU – realne scenariusze

Modele generowania grafiki, takie jak Stable Diffusion i jego odmiany, są dużo cięższe niż małe LLM‑y tekstowe. Z tego powodu sensowna praca z nimi nadal w ogromnej większości ląduje na GPU. NPU w dzisiejszej formie może jednak:

- przejąć niektóre etapy przetwarzania, np. wstępne enkodowanie/ dekodowanie obrazu,

- obsłużyć mniejsze, specjalizowane modele – np. upscalery, denoisery, proste style artystyczne,

- przyspieszyć generowanie miniatur lub szkiców, zanim GPU „dociągnie” wynik do pełnej rozdzielczości.

Praktyczny przykład: aplikacja graficzna na laptopie może błyskawicznie stworzyć niską rozdzielczość podglądu sceny z użyciem NPU, żeby użytkownik mógł szybko dopracować prompt czy parametry. Dopiero zaakceptowany wariant leci na GPU w pełnej jakości. Daje to wrażenie „lekkości” narzędzia, mimo że gdzieś pod spodem dzieje się ciężka magia.

Transkrypcja i tłumaczenie w jednym ciągu na NPU

Ciekawym rodzajem modeli generatywnych, które dobrze wpisują się w możliwości NPU, są modele typu speech‑to‑text‑to‑speech oraz speech‑to‑text‑to‑text. Ich zadanie to:

- zamienić mowę na tekst,

- przetłumaczyć ten tekst na inny język,

- opcjonalnie wygenerować z powrotem mowę syntetyczną.

Cały łańcuch można rozbić na kilka mniejszych modeli, z których każdy mieści się w możliwościach NPU. Dzięki temu da się zbudować quasi‑symultaniczne tłumaczenie offline – np. podczas rozmowy wideo. Latencja będzie nieco większa niż przy potężnych modelach chmurowych, ale za to dane głosowe nie opuszczą urządzenia, a baterii starczy na dłużej.

Kompresja modeli: jak „upchnąć” AI w NPU

Żeby model dało się wygodnie uruchomić na mobilnym NPU, producenci i deweloperzy stosują kilka sztuczek:

- kwantyzacja – zmiana typu danych z 16/32‑bitowych na 8, 4, a nawet 2 bity przy jak najmniejszej utracie jakości,

- przycinanie (pruning) – usuwanie neuronów/połączeń, które mają minimalny wpływ na wynik,

- distillation – trenowanie małego modelu, żeby naśladował zachowanie dużego „nauczyciela”.

Efekt jest taki, że ten sam „pomysł na model” można mieć w kilku wersjach: ciężką, precyzyjną dla GPU w centrum danych oraz lekką, kompresowaną pod NPU w laptopie. Windows i aplikacje mogą wtedy decydować dynamicznie: gdy dostępne jest duże GPU lub połączenie z chmurą, korzystają z wersji „pełnotłustej”, a w trybie offline lub na baterii – z modelu zminiaturyzowanego.

Hybryda chmura + NPU przy modelach generatywnych

Rosnąca liczba rozwiązań idzie w stronę architektury hybrydowej. Zakłada ona, że:

- NPU na laptopie wykonuje lokalnie to, co dotyczy danych wrażliwych (wstępna anonimizacja, filtrowanie, streszczanie),

- chmura dostaje tylko „odchudzony” opis, bez niepotrzebnych szczegółów osobistych,

- duży model w chmurze odpowiada w sposób bardziej kreatywny i pełny, niż potrafiłby lokalny mini‑model.

Z perspektywy użytkownika może to wyglądać jak jeden asystent. Część odpowiedzi powstanie całkowicie offline, inne będą wzbogacane przez modele chmurowe. NPU służy tu jako inteligentny „filtr brzegowy” – obsługuje zadania, które da się sensownie zrobić lokalnie, i dba o to, by do internetu wysyłać tylko to, co konieczne.

Gdzie są dziś największe ograniczenia NPU dla generatywnej AI

Mimo szybkiego rozwoju, dzisiejsze NPU w laptopach mają kilka twardych barier:

- pamięć – zarówno jej ilość, jak i przepustowość ogranicza rozmiar modeli i długość kontekstu (np. ile tekstu na raz „widzi” model językowy),

- elastyczność – część egzotycznych warstw i architektur trzeba przepisać lub uprościć, by pasowały do wspieranych operatorów NPU,

- narzędzia – debugowanie, profilowanie i optymalizacja modeli pod NPU są wciąż trudniejsze niż pod GPU, co spowalnia rozwój aplikacji.

Dlatego najbardziej realistyczny obraz na najbliższe lata to NPU jako wyspecjalizowany silnik do „małej” generatywnej AI – tej, która potrzebuje niskich opóźnień, prywatności i długiej pracy na baterii – podczas gdy duże, spektakularne modele pozostaną domeną GPU i serwerowni. W codziennym użyciu może się jednak okazać, że to właśnie te „małe” modele działające lokalnie są używane najczęściej, a chmura staje się tylko dodatkiem, gdy naprawdę ją potrzeba.

Bardzo ciekawy artykuł, który rzetelnie omawia nowe układy NPU w laptopach z Windows i ich funkcje dla narzędzi AI offline. Podoba mi się, że autor przybliżył czytelnikom, jakie korzyści mogą płynąć z wykorzystania tych układów w praktyce. Jednakże brakuje mi bardziej pogłębionego porównania różnych modeli laptopów z takimi układami NPU oraz ich wydajności w konkretnych zadaniach AI offline. Wartościowe byłoby również poruszenie tematu ewentualnych problemów z kompatybilnością tych układów z różnymi programami AI. W sumie, interesujący artykuł, ale trochę brakuje mi bardziej szczegółowych informacji.

Tylko zalogowani mają tu głos w komentarzach.