Dlaczego teraz jest dobry moment na startup AI w Polsce

Okno szansy technologicznej i biznesowej

Budowa startupu AI w Polsce jeszcze kilka lat temu wymagała milionowych budżetów, własnych serwerowni i zespołu doktorów z uczelni technicznych. Dziś jedna mała ekipa może w kilka tygodni wypuścić sensowny produkt AI, korzystając z gotowych modeli językowych, chmury i narzędzi no-code. Zmieniło się wszystko: tempo rozwoju technologii, dostępność rozwiązań oraz świadomość biznesu, że bez AI przegra wyścig konkurencyjny.

Rynek globalny jest pełen głośnych narzędzi ogólnego przeznaczenia (generatorów tekstu, obrazów, kodu). To obszary, gdzie konkurencja jest już brutalna, a „zielone pole” praktycznie zniknęło. Za to wciąż jest ogromna przestrzeń w wąskich segmentach: specjalistyczne rozwiązania dla konkretnych branż, automatyzacja niszowych procesów, produkty silnie osadzone w lokalnym kontekście i języku polskim.

Polska ma w tym układzie ciekawą pozycję. Z jednej strony jest zapleczem talentów technicznych dla całej Europy (silne uczelnie, duża liczba programistów i inżynierów danych), z drugiej – wielu z tych ludzi pracuje jako podwykonawcy, nie budując własnych produktów. Luka między kompetencjami technicznymi a komercjalizacją jest ogromna. Dla przedsiębiorczych inżynierów, product managerów i sprzedawców to czyste złoto.

Rynek AI w Polsce: gdzie jest tłoczno, a gdzie wciąż pusto

Globalnie nasyciły się głównie „modne” kategorie B2C: kreatory treści, proste chatboty, generatory obrazów. Konkurencja jest wysoka, bariery wejścia technologicznie niskie, a różnicowanie produktu trudne. W Polsce te same trendy są widoczne z opóźnieniem, ale kopiowanie Zachodu rzadko ma sens – polski rynek jest mniejszy, więc trudniej utrzymać się z masowego, taniego produktu.

Dużo więcej „zielonego pola” jest w obszarach, w których Polska ma silną gospodarkę, ale słabą cyfryzację procesów:

- Produkcja i przemysł – predykcja awarii, optymalizacja zużycia energii, kontrola jakości z wykorzystaniem wizji komputerowej.

- Logistyka i transport – optymalizacja tras, automatyzacja dokumentów transportowych, inteligentne planowanie załadunku.

- Medycyna i zdrowie – analiza dokumentacji medycznej, wsparcie diagnostyki, automatyzacja administracji w przychodniach.

- Finanse i ubezpieczenia – scoring ryzyka, wykrywanie fraudów, automatyzacja obsługi klienta w back-office.

- Automatyzacja biurowa – inteligentne przetwarzanie dokumentów, raportów, umów, workflow w dużych firmach i urzędach.

- Sektor publiczny – systemy kolejkowe, analiza wniosków, chatboty obsługujące obywateli w bezpieczny, zgodny z przepisami sposób.

W każdym z tych sektorów leży mnóstwo nieprzepracowanych problemów, które są realnym kosztem dla firm i instytucji. Te problemy są powtarzalne, mierzalne i – co ważne – decydenci rozumieją już, że AI może tu realnie pomóc, o ile ktoś potrafi przełożyć technologię na rozwiązanie biznesowe.

Polska: niskie koszty, UE, granty – i kilka ograniczeń

Budowa startupu AI w Polsce ma kilka przewag strukturalnych. Po pierwsze, koszt zespołu – nadal niższy niż w Niemczech, Francji czy w Skandynawii, przy porównywalnych umiejętnościach technicznych. To pozwala zbudować solidne MVP AI przy mniejszym kapitale startowym. Po drugie, dostęp do rynku UE: można sprzedawać produkt od początku z myślą o klientach z Niemiec czy Holandii, jednocześnie prowadząc operacje z Polski.

Kolejnym atutem są granty i wsparcie publiczne – NCBR, PARP, programy regionalne, fundusze akceleracyjne. Prawdopodobnie nie zbudują za ciebie całej firmy, ale mogą pokryć część kosztów badań, rozwoju, prototypu czy internacjonalizacji. Dla inwestorów prywatnych dodatkowe programy współfinansowania też bywają argumentem.

Ograniczenia są równie ważne. Polski rynek wewnętrzny jest relatywnie mały, szczególnie w B2C, więc trzeba myśleć globalnie od początku. Konkurencja nie śpi – bardzo łatwo o sytuację, w której amerykański lub niemiecki startup wejdzie z podobnym rozwiązaniem szybciej i agresywniej. Dochodzi kwestia regulacji: AI Act, RODO, lokalne przepisy sektorowe (np. medyczne, finansowe). To wymusza od początku poważne podejście do zgodności z prawem – ale z drugiej strony stanowi barierę, która może cię chronić przed „dziką” konkurencją bez takiego przygotowania.

Od „fajnego pomysłu na AI” do realnego problemu klienta

Gdzie szukać problemów pod startup AI

Większość osób zaczyna od zdania: „Zróbmy coś z AI, bo to przyszłość”. To drogowskaz prosto w ślepą uliczkę. AI jest tylko narzędziem. Narzędzie ma sens wyłącznie wtedy, gdy rozwiązuje konkretny, bolesny problem dla grupy klientów, którzy są gotowi zapłacić za jego usunięcie.

Najprostsza metoda szukania pomysłów na startup AI w Polsce to wejście w buty osoby z konkretnej branży. Zamiast pytać „jak użyć modeli językowych?”, lepiej spytać: „Jakie czynności w tej firmie są żmudne, ręczne, powtarzalne, oparte na tekście, liczbach lub obrazach?”. AI jest szczególnie dobre tam, gdzie trzeba analizować dużo nieustrukturyzowanych danych – dokumentów, maili, zgłoszeń, zdjęć, nagrań.

Praktyczne miejsca na research:

- rozmowy z osobami z branży (szczególnie „środkowy szczebel”: kierownicy, specjaliści, team leaderzy),

- ogłoszenia o pracę – po obowiązkach widać ręczne, powtarzalne procesy,

- fora branżowe, grupy na LinkedIn i Facebooku, gdzie ludzie narzekają na codzienne utrapienia,

- raporty branżowe i case studies dużych firm (widać, jakie obszary już automatyzują, a które wciąż są w tyle).

Dobrym znakiem jest sytuacja, gdy pracownicy od lat „łatali” proces Excelem, kopiuj-wklej i ręcznymi obejściami. Takie miejsca są wręcz stworzone do automatyzacji AI – prościej pokazać im, że mogą przestać robić coś ręcznie, niż przekonywać, że potrzebują zupełnie nowej „zabawki AI”.

Prosta matryca oceny: jak nie zakochać się w swoim pomyśle

Gdy masz już kilka pomysłów, przydaje się prosty filtr, który zmniejszy ryzyko, że stracisz rok życia na coś, czego nikt nie chce. Pomaga tutaj matryca oparta na czterech wymiarach:

- Częstotliwość problemu – jak często klient się z nim mierzy? Codziennie, raz na tydzień, raz na rok?

- Intensywność bólu – ile to kosztuje czasu, nerwów, pieniędzy? Czy menedżerowie widzą to w raportach jako realny koszt?

- Gotowość do zapłaty – czy firma już płaci za „łatające” rozwiązania (nadgodziny, zewnętrznych konsultantów, licencje innych narzędzi)?

- Dojrzałość danych – czy dane potrzebne AI istnieją i są choć częściowo dostępne (systemy, pliki, bazy)?

Pomysł z wysoką częstotliwością i wysokim bólem, przy średniej dojrzałości danych, jest często o wiele lepszy niż pomysł „genialny” technologicznie, ale dotyczący rzadkiego zdarzenia. Dla startupu AI w Polsce, który chce w kilka miesięcy dojść do MVP i pierwszych klientów, lepiej celować w nudne, ale drogie w skali roku procesy.

Przykład: średniej wielkości kancelaria prawna zatrudnia ludzi, którzy ręcznie przeklejają dane z umów do systemu. Problem jest częsty (codziennie), kosztowny (wysokie stawki godzinowe prawników lub asystentów), uciążliwy (monotonne zadanie), a dane są już w formie cyfrowej (PDF, Word). To wręcz książkowy kandydat na automatyzację z użyciem modeli językowych.

Pierwsze rozmowy z potencjalnymi klientami: pytania, które odzierają z iluzji

Zanim napiszesz linijkę kodu, usiądź z 10–20 osobami, które mogłyby być docelowymi klientami. Bez slajdów. Bez demka. Bez „sprzedawania wizji AI”. Po prostu spróbuj zrozumieć ich dzień pracy. Kilka pytań, które działają w polskich realiach lepiej niż pitching:

- „Opowiedz, jak wygląda typowy dzień/tydzień twojej pracy – z czego jesteś rozliczany?”

- „Jakie zadania są najbardziej żmudne, frustrujące, ale muszą być zrobione?”

- „Co odkładasz na koniec dnia lub tygodnia, bo jest nudne albo męczące?”

- „Czy macie na to jakieś wewnętrzne obejścia? Makra, Excela, dodatkowych ludzi?”

- „Gdybyś mógł/a zautomatyzować trzy rzeczy w swojej pracy, co by to było?”

- „Czy wasza firma płaci dziś za narzędzia lub usługi, które częściowo rozwiązują ten problem?”

- „Jak mierzony jest koszt tego problemu – w czasie, błędach, pieniądzach?”

Rozmowę warto kończyć bez prezentowania swojej koncepcji. Jeśli na siłę tłumaczysz, co chcesz zbudować, jest ryzyko, że rozmówca zacznie ci przytakiwać z grzeczności. Chodzi o surowy obraz rzeczywistości, a nie o potwierdzenie, że „pomysł jest super”.

Jak rozpoznać „zabawkę AI” po kilku dniach researchu

„Zabawka AI” to produkt, który jest efektowny, ale nie rozwiązuje istotnego problemu. Ludzie mówią „wow” na demie, ale nie płacą za używanie. Parę sygnałów ostrzegawczych:

- problem pojawia się rzadko („raz na kwartał”),

- klient nie ma go w żadnym raporcie, bo nie jest mierzony jako koszt,

- wartość rozwiązania trudno ubrać w liczby (oszczędzone godziny, mniej błędów, wyższa sprzedaż),

- rynek jest skrajnie rozproszony, a koszt dotarcia do pojedynczego klienta jest wysoki,

- podobnych gadżetów AI jest już masa, a marginalne różnice nie przekładają się na przewagę.

Jeżeli po kilku rozmowach słyszysz głównie „fajne”, „ciekawy pomysł”, ale nikt nie potrafi odpowiedzieć, ile by za to zapłacił i jakie procesy mógłby dzięki temu wyciąć, sygnał jest jasny. Lepiej porzucić pomysł na wczesnym etapie niż rok później wyjaśniać inwestorowi, dlaczego „wszyscy się zachwycali, a nikt nie kupił”.

Zespół założycielski – jakie kompetencje są naprawdę potrzebne

Model „trzech kapeluszy”: produkt, technologia, sprzedaż

Budowa startupu AI w Polsce kusi wiele osób solo – jeden inżynier lub product manager próbuje ogarnąć wszystko. Teoretycznie się da, praktycznie rzadko kończy się sukcesem. Najczęściej brakuje przynajmniej jednego z trzech „kapeluszy”:

- Produkt – kto rozumie klienta i potrafi przełożyć potrzeby na roadmapę funkcji,

- Technologia/AI – kto jest w stanie realnie zbudować działające rozwiązanie i ocenić jego ograniczenia,

- Sprzedaż/Bizdev – kto nie boi się telefonu, maila i spotkań, domyka pilotaże, negocjuje warunki.

W małym zespole te role często się przenikają, ale dobrze, żeby było jasne, kto za co odpowiada. Dzięki temu nie ma sytuacji, w której wszyscy „myślą o produkcie”, a nikt nie rozmawia z klientami, albo wszyscy „kodują”, a nikt nie sprawdza, czy to w ogóle będzie komu sprzedać.

Product founder: tłumacz między technologią a klientem

Rola założyciela odpowiedzialnego za produkt jest często niedoceniana. To osoba, która spędza dużo czasu z klientami, rozumie procesy biznesowe i potrafi nazwać, co jest „must-have”, a co tylko „fajnym dodatkiem”. W kontekście MVP AI to szczególnie ważne, bo łatwo wpaść w pułapkę dokładania kolejnych „magicznych” funkcji modeli językowych.

Product founder powinien:

- mieć dobrą intuicję branżową (często pochodzi z danej branży lub długo z nią pracował),

- umieć prowadzić rozmowy rozpoznawcze z klientami, bez wciskania od razu rozwiązania,

- potrafić spisać wymagania w formie prostych user stories/scenariuszy,

- odporność na „feature creep” – gdy klienci proszą o dziesiątki zmian, trzyma priorytety.

To on dba, by pierwsze MVP naprawdę rozwiązywało kluczowy problem, a nie demonstrowało wszystkie możliwości AI. Przy startupach AI w Polsce często najlepszego product foundera stanowi osoba, która sama pracowała w danej branży (np. lekarz, prawnik, logistyk), a dopiero potem przeszła w świat technologii.

Tech/AI founder: inżynier, który myśli o kosztach i ograniczeniach

W startupie AI techniczny współzałożyciel jest trochę jak konstruktor mostów: musi umieć policzyć nie tylko, czy most się utrzyma, ale też ile będzie kosztował beton. W praktyce oznacza to łączenie dobrego warsztatu inżynierskiego z trzeźwym spojrzeniem na ceny GPU, limity API i czas developmentu.

Tech/AI founder w polskich realiach powinien:

- rozumieć podstawy uczenia maszynowego i modeli językowych (ale niekoniecznie być naukowcem z publikacjami),

- umieć zbudować end-to-end prototyp: od prostego frontu, przez backend, po integrację z API modeli,

- znać podstawy MLOps/DevOps na tyle, by wdrożyć MVP na chmurze i móc je monitorować,

- mieć wyczucie kosztów: jak różne decyzje architektoniczne przekładają się na rachunki za infrastrukturę,

- nie bać się powiedzieć „tego się nie da zrobić wiarygodnie” – i tym samym uratować produkt przed obietnicami bez pokrycia.

Przy AI potrzebna jest szczególna uczciwość. Jeśli model ma 70–80% skuteczności, a biznes wymaga 99%, trzeba umieć to jasno wytłumaczyć product founderowi i klientowi. Lepiej zaprojektować proces, w którym człowiek zatwierdza decyzje modelu, niż sprzedać „pełną automatyzację”, która później generuje błędy i spalone zaufanie.

Sprzedaż/Bizdev founder: człowiek, który wstaje od komputera

Sprzedaż w startupie AI to nie jest „wrzucenie posta na LinkedInie”. Ktoś musi systematycznie dzwonić, pisać, umawiać demo, dopytywać po spotkaniu. Często to właśnie sprzedażowiec jest pierwszą osobą, z którą klient buduje relację – technologia pojawia się dopiero później.

Dobra osoba od sprzedaży w startupie AI w Polsce:

- rozumie, jak działają procesy zakupowe w firmach (procurement, bezpieczeństwo, prawo),

- potrafi rozwiać obawy dotyczące RODO, bezpieczeństwa danych i „magiczności” AI,

- nie boi się wczesnego feedbacku: kiedy produkt jest jeszcze surowy, a klient marudzi,

- umie negocjować pilotaże płatne zamiast „darmowych testów bez końca”,

- spisuje wnioski z rozmów i przekłada je na priorytety dla zespołu produktowo-technicznego.

W praktyce w wielu polskich startupach tę rolę na początku pełni product founder albo CEO, ale ważne, by ktoś miał ją na własność. Jeśli „wszyscy trochę sprzedają”, to zwykle oznacza, że nikt nie ma targetu, CRM jest pusty, a pipeline sprzedaży istnieje tylko w głowach.

Czy da się wystartować solo?

Oczywiście, że się da – mnóstwo projektów open-source i małych SaaS-ów startowało w pojedynkę. Pytanie brzmi: z jakim ryzykiem i w jakim tempie? Solo founder w AI najczęściej ma dwie drogi:

- short-term consulting + produkt – najpierw świadczy usługi (np. buduje małe wdrożenia AI na zamówienie), a po godzinach wyciąga z nich wspólny produkt,

- mikroprodukt B2C / dla developerów – prosty tool, plugin, integracja, którą można zbudować i sprzedawać niemal bez sprzedaży bezpośredniej.

Przy ambicji zbudowania poważnego produktu B2B w Polsce (sprzedawanego do firm) zderzenie z rzeczywistością przychodzi szybko: trzeba jednocześnie rozwijać produkt, dopinać kwestie prawne, rozmawiać z klientami, ogarniać faktury. Tu drugi lub trzeci współzałożyciel dramatycznie zwiększa szanse powodzenia.

Jak skompletować zespół w Polsce bez wielkiego budżetu

Zamiast od razu dzielić udziały na trzy równe części, rozsądniej jest zacząć od współpracy „na próbę”. Kilka praktycznych ścieżek:

- projekt weekendowy / hackathonowy – razem budujecie prosty prototyp przez 2–3 tygodnie; po tym czasie zwykle czuć, czy jest „chemia” i wspólna etyka pracy,

- wspólne rozmowy z klientami – zanim cokolwiek zakodujecie, chodzicie razem na spotkania; widać, kto słucha, kto dominuje, a kto znika,

- umowa o współpracy z opcją wejścia na udziały – na początku ktoś jest na B2B/fakturę na kilka godzin tygodniowo, a dopiero po 3–6 miesiącach rozmawiacie o equity.

W polskich warunkach silnym kanałem są też społeczności: grupy AI/ML na Facebooku, LinkedIn, meetupach, Slackach. Tam często znajdziesz ludzi, którzy mają dosyć korporacji i szukają sensownego projektu, ale nie chcą od razu rzucać pracy. Krótkie „zadanie próbne” dla wszystkich stron chroni przed sytuacją, w której po pół roku odkrywacie, że macie zupełnie inny poziom zaangażowania.

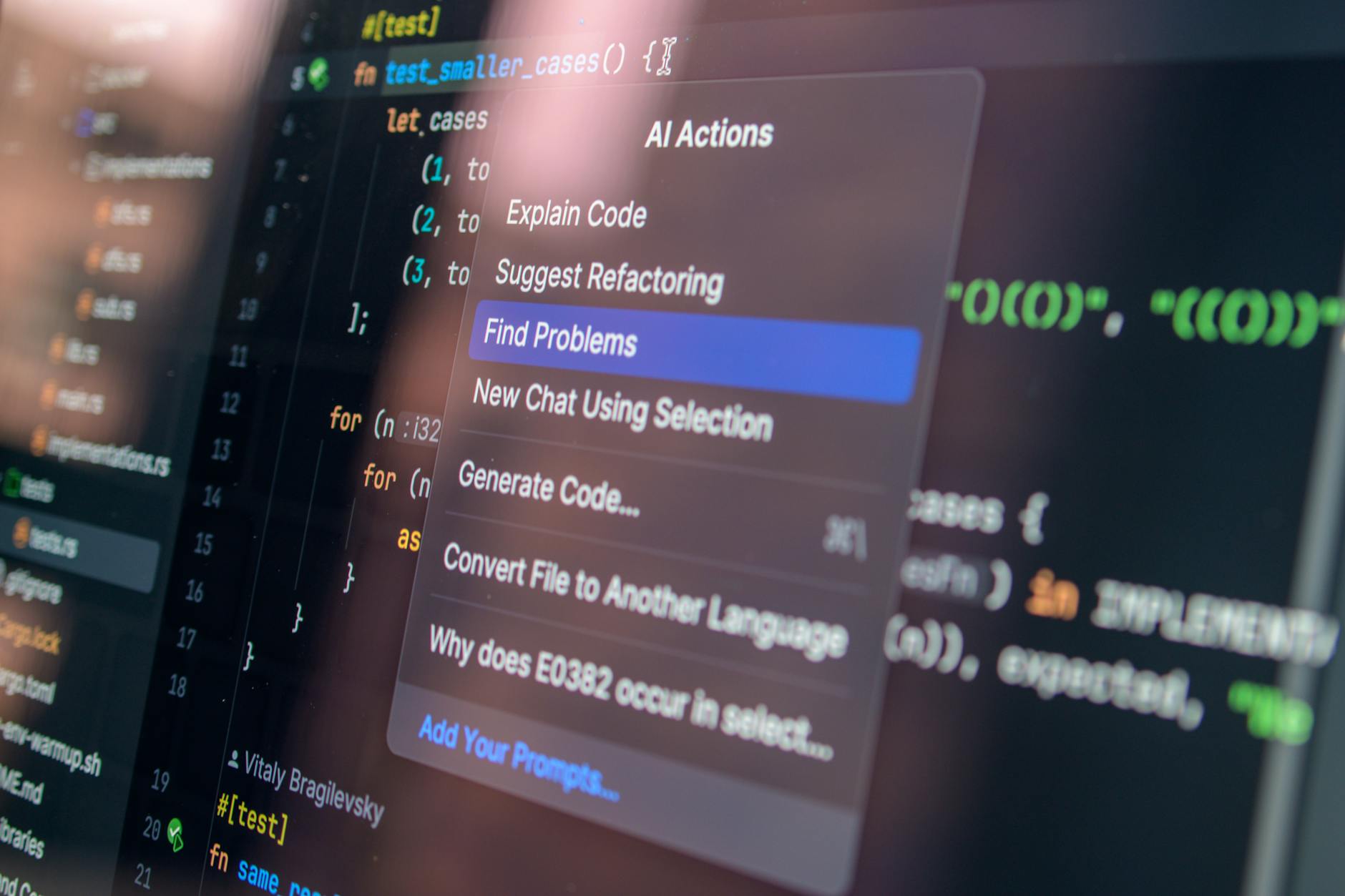

Wybór technologii i architektury: nie komplikuj na starcie

API vs własny model: co naprawdę trzeba trenować

Polski founder AI bardzo często zaczyna od pytania: „kiedy powinniśmy wytrenować własny model?”. W dziewięciu przypadkach na dziesięć odpowiedź brzmi: nie teraz. Na etapie MVP kluczowe jest sprawdzenie, czy ktokolwiek chce płacić za rozwiązanie, a nie budowa unikalnej infrastruktury ML.

Najprostszy schemat na start:

- użyć gotowych modeli przez API (OpenAI, Anthropic, Claude, Mistral przez dostawców, modele z polskim kontekstem tam, gdzie potrzeba),

- unikać custom trainingu, jeśli da się osiągnąć sensowny wynik przez prompt engineering i kilka reguł biznesowych,

- dodać warstwę logiki wokół modelu: walidację, proste reguły, workflow, a nie tylko „chatbota z pudełka”.

Własny model zaczyna mieć sens, gdy:

- koszt API przy realnym użyciu rośnie szybciej niż przychody,

- musisz działać w środowisku on-premise (np. banki, instytucje publiczne) i klient wymaga pełnej kontroli nad modelem,

- potrzebujesz specjalistycznego języka lub formatów, gdzie modele ogólne wypadają słabo.

Nawet wtedy można zacząć od fine-tuningu gotowych open-source’owych modeli zamiast od pełnego treningu od zera. W Polsce rzadko ma się budżet i dane na budowę „polskiego GPT”, a inwestorzy wolą zobaczyć rosnący przychód niż kolejny klaster GPU.

Stos technologiczny pod MVP: prościej niż w korpo

Przy wyborze stacku technicznego kusi, żeby kopiować duże firmy: mikroserwisy, Kubernetes, skomplikowane CI/CD. Dla małego startupu to jak kupowanie ciężarówki do przewiezienia jednej walizki. Na etapie MVP liczy się szybkość iteracji i łatwość zmiany decyzji.

Przykładowy, wystarczający stos na start:

- backend: Python (FastAPI, Django) lub Node.js – coś, co zespół dobrze zna,

- frontend: prosty React/Next.js lub gotowy panel administracyjny,

- baza danych: Postgres (plus ewentualnie Redis na cache),

- AI layer: integracja z jednym lub dwoma dostawcami API, biblioteki typu LangChain/LlamaIndex – o ile faktycznie pomagają, a nie komplikują,

- hosting: chmura z niskim progiem wejścia (Render, Railway, Heroku-owe odpowiedniki, AWS/GCP/Azure z prostą konfiguracją).

Wielu założycieli w Polsce wybiera to, co znają z poprzednich projektów, i to jest zwykle dobra decyzja. Liczy się to, czy jesteście w stanie w tydzień dodać funkcję, a nie to, czy architektura wygląda idealnie w diagramach.

Architektura pod AI: myśl przepływem, nie modelem

Modele lingwistyczne czy klasyfikatory są tylko jednym z klocków w układance. Kluczem jest cały przepływ danych: od wejścia (dokument, mail, formularz) do wyjścia (raport, rekord w CRM, powiadomienie). Dobrze jest naszkicować ten przepływ jak prostą mapkę metra:

- Skąd przychodzą dane? (upload pliku, webhook z innego systemu, API klienta)

- Jak są wstępnie przetwarzane? (OCR, czyszczenie tekstu, normalizacja)

- Gdzie wchodzi AI i co dokładnie ma zrobić? (ekstrakcja pól, streszczenie, klasyfikacja)

- Jak weryfikujesz wynik? (reguły biznesowe, walidacja przez człowieka, porównanie z wzorcem)

- Gdzie wynik ląduje? (CRM, ERP, mail, dashboard, plik)

Przykład: automat do czytania umów. Sam model, który „rozumie” umowy, to za mało. Trzeba ogarnąć upload (w tym skany), konwersję do tekstu, rozpoznawanie stron umowy, mapowanie klauzul na konkretne pola w systemie, logikę błędów oraz wersjonowanie dokumentów. Bez tego AI staje się tylko drogą biblioteką, która generuje ładny tekst, ale nie oszczędza realnego czasu.

Bezpieczeństwo i prywatność: minimum, którego wymagają polskie firmy

Nawet przy MVP klienci w Polsce coraz częściej pytają o kwestie bezpieczeństwa danych. Nie trzeba od razu mieć certyfikatu ISO, ale kilka fundamentów robi różnicę:

- szyfrowanie danych w spoczynku i w tranzycie (HTTPS, szyfrowane bazy),

- separacja danych klientów – tak, by nie wpaść w pułapkę mieszania danych między firmami,

- kontrola dostępu – kto w zespole może zobaczyć produkcyjne dane, a kto tylko dane zanonimizowane,

- jasne komunikaty do klientów, gdzie fizycznie przechowywane są dane (regiony chmurowe, dostawcy),

- umowy powierzenia danych z dostawcami (szczególnie, gdy wysyłasz teksty do zewnętrznych API).

Do tego dochodzi klasyczny RODO: prawo do bycia zapomnianym, dostęp do danych, logi operacji. Można zacząć prosto – ważne, by od początku mieć świadomość, jakie dane zbierasz i gdzie one płyną. Wielu polskich klientów z sektora finansowego czy medycznego w ogóle nie wejdzie w pilotaż, jeśli na te pytania nie masz choćby podstawowych odpowiedzi.

Monitoring i obserwowalność: co mierzyć w AI MVP

Normalne aplikacje mierzą liczbę użytkowników, błędy, czas odpowiedzi. Produkty AI wymagają jeszcze kilku dodatkowych wskaźników. Bez nich możesz nie zauważyć, że model od miesiąca „głupieje” na nowych typach danych.

Na starcie przydaje się:

- logowanie zapytań i odpowiedzi modelu (oczywiście z anonimizacją, jeśli trzeba),

- tagowanie przypadków, które były poprawione ręcznie przez człowieka,

- prosta metryka jakości – np. procent pól wyekstrahowanych poprawnie, ocena eksperta dla próbki wyników,

- koszty na poziomie użytkownika/procesu – ile kosztuje obsługa jednego dokumentu/zadania przez AI.

W praktyce w wielu polskich zespołach rolę „systemu oceny” pełni na początku Excel lub prosty panel admina, gdzie intern lub junior codziennie przechodzi przez losową próbkę wyników modelu i zaznacza, co było poprawne. To mało sexy, ale daje realne dane do decyzji o poprawkach.

Dane – paliwo dla AI i największy ból na starcie

Skąd wziąć pierwsze dane treningowe w Polsce

Większość pomysłów na startup AI rozbija się nie o brak GPU, tylko o brak sensownych danych. Czasem founder mówi: „branża jest super, tylko nikt nie ma danych w formie cyfrowej”. To zwykle oznacza, że trzeba zmienić segment lub inaczej podejść do produktu, a nie czekać na cud.

Kilka źródeł danych do MVP:

- dane klienta pilotażowego – mała firma, która zgodzi się udostępnić własne zanonimizowane dane w zamian za niższą cenę lub dodatkowe funkcje,

- dane publiczne – rejestry państwowe, orzeczenia sądów, raporty, ogłoszenia przetargowe, oferty pracy,

- generowanie syntetyczne – tworzenie przykładowych dokumentów/zdarzeń na bazie realnej struktury, ale z fikcyjnymi danymi,

- własne „scrapy” – dane zbierane z internetu, ale zgodnie z regulaminami serwisów i prawem autorskim.

Realistyczny scenariusz: dogadujesz się z jedną kancelarią lub firmą logistyczną, która daje kilkaset lub kilka tysięcy dokumentów do pilotażu. W zamian dostaje pierwszeństwo funkcji, rabat i poczucie współtworzenia narzędzia. Przy dobrze poprowadzonej relacji taka firma często staje się później ambasadorem rozwiązania na rynku.

RODO, tajemnica przedsiębiorstwa i dane wrażliwe

Przy danych w Polsce bardzo szybko pojawiają się trzy słowa: RODO, tajemnica przedsiębiorstwa, dane wrażliwe. Nie da się ich zignorować, zwłaszcza gdy pracujesz z danymi medycznymi, finansowymi czy HR-owymi.

Podstawowy „zestaw bezpieczeństwa” na start:

- umowa powierzenia przetwarzania danych między twoją spółką a klientem,

Anonimizacja i pseudonimizacja w praktyce

Hasło „zróbmy anonimizację” brzmi prosto, aż do momentu, gdy trzeba napisać pierwsze reguły. Kluczem jest decyzja, co naprawdę musi zostać w danych, żeby model miał sens, a co możesz spokojnie wyciąć lub zamienić na placeholdery.

Przydaje się krótki warsztat z klientem: bierzecie kilkanaście realnych dokumentów i przechodzicie je linijka po linijce. Ustawiacie słowniki i reguły: PESEL na [PESEL], numery konta bankowego na [NR_KONTA], nazwy osób fizycznych na [OSOBA], kwoty możecie zaokrąglać lub skalować. Czasem wystarczy, że struktura i relacje między polami zostaną, a konkretne wartości nie są istotne.

Technicznie najczęściej łączy się kilka podejść:

- reguły oparte na wzorcach (regexy dla PESEL, NIP, kont bankowych, numerów rejestrowych),

- rozpoznawanie encji (NER) – modele, które wyłapują imiona, nazwiska, nazwy firm, lokalizacje,

- white‑listy i black‑listy – nazwy działów, procedur, produktów, których nie trzeba anonimizować.

Dobrym trikiem jest trzymanie osobnego, dobrze zabezpieczonego słownika mapowań (np. id klienta → placeholder), jeśli musisz później cofnąć anonimizację w produkcji. W środowisku treningowym pracujesz wtedy tylko na „płaskich” placeholderach, bez realnych nazwisk i numerów.

Gdy klient nie może „wypuścić” danych z firmy

Częsta scena w Polsce: spotkanie idzie świetnie, aż do momentu, gdy pada pytanie o wysyłanie dokumentów do chmury. „My mamy własne serwery, nic nie może wyjść na zewnątrz” – i rozmowa zwalnia. To nie musi być ściana, raczej inny tryb współpracy.

Najpopularniejsze opcje:

- instalacja on-premise – wasz system (lub jego część) ląduje w infrastrukturze klienta; trudniejsze na start, ale czasem jedyne wyjście dla banków czy szpitali,

- dedykowany tenant w chmurze – osobne środowisko w wybranym regionie (np. Warszawa/Frankfurt), z jasno opisaną izolacją danych,

- hybryda – dane wrażliwe są przetwarzane lokalnie (np. pre‑processing, anonimizacja), a do chmury wysyłany jest tylko „odchudzony” tekst.

Na etapie MVP często wystarcza prosta, ale uczciwa mapa: co dzieje się w sieci klienta, co trafia do waszej chmury, a co do zewnętrznego API. Dobrze narysowany diagram (nawet na kartce) potrafi rozbroić połowę obaw działu bezpieczeństwa.

Budowa własnego datasetu krok po kroku

Zamiast marzyć o „dużym, czystym zbiorze”, lepiej podejść do danych tak, jak do produktu – iteracyjnie. Zaczynasz od małej, ale dobrze opisanej próbki, i budujesz na niej kolejne warstwy.

Sprawdza się prosty rytm pracy:

- Pierwsza garść danych – kilkaset dokumentów od pilotażowego klienta lub z publicznych źródeł.

- Proste etykiety – na początek kilka kluczowych pól lub tagów (np. typ dokumentu, status, 2–3 pola biznesowe).

- Ręczne oznaczanie – robione przez jedną osobę z biznesu i jedną techniczną, żeby „język domenowy” się zsynchronizował.

- Pierwsza wersja modelu – nie idealna, ale na tyle dobra, żeby przyspieszyć dalsze oznaczanie (model podpowiada, człowiek poprawia).

- Pętla feedbacku – co tydzień przegląd najczęstszych błędów i korekta schematu etykietowania.

Jedna z polskich firm logistycznych zaczynała od ręcznego wprowadzania pól z listów przewozowych do Excela. Dopiero po kilkunastu dniach, gdy zrozumieli, które pola są naprawdę istotne dla rozliczeń i KPI, zdecydowali, co model ma wyciągać automatycznie. Gdyby etykietowali „wszystko, bo może się przyda”, ugrzęźliby na miesiące.

Współpraca z klientem przy etykietowaniu

Największym błędem jest zamknięcie się w pokoju z danymi i budowanie „magicznego” modelu, który klient zobaczy dopiero za kilka miesięcy. Przy danych biznesowych klient musi mieć poczucie współwłasności – inaczej zacznie się bać, że „oddaje know‑how”.

Praktyczne podejście:

- ustalić jasny zakres – co dokładnie oznaczacie i po co,

- pokazać klientowi prosty panel do przeglądania i poprawiania wyników modelu,

- raz na tydzień lub dwa wspólnie przejść kilkadziesiąt przypadków spornych i spisać zasady,

- sprawić, by przynajmniej jedna osoba po stronie klienta była „product ownerem danych”.

Takie sesje nie tylko poprawiają jakość datasetu – często ujawniają też rozjazd między tym, jak proces „powinien wyglądać na papierze”, a tym, jak faktycznie działa w firmie.

Jakość danych ważniejsza niż ilość

Pokusą jest zbieranie jak największej liczby dokumentów. Tylko że tysiące krzywo zeskanowanych, niespójnych i źle opisanych plików potrafią zepsuć model bardziej niż pomóc. Lepiej mieć kilkaset przykładów, ale dobrze opisanych i spójnych, niż morze śmieci.

Przydatna jest prosta checklista jakości:

- czy dokumenty są reprezentatywne dla realnego procesu (nie same „ładne przypadki”),

- czy etykiety są opisywane według jednego, zrozumiałego schematu,

- czy ktoś z biznesu zatwierdził definicje pól (np. „data rozpoczęcia umowy” – co dokładnie to znaczy?),

- czy macie choć małą porcję „trudnych przypadków” – błędy, wyjątki, ręczne dopiski.

Jeśli model działa świetnie na ładnych dokumentach demo, a sypie się na pierwszym skanie z krzywo ustawionej drukarki, klienci szybko stracą cierpliwość. Dlatego im wcześniej wpuścisz do zbioru te „brzydkie” przykłady, tym lepiej.

Architektura danych dla AI – spójność ponad fajerwerki

Przy pierwszym MVP wystarczy często jedna baza i kilka tabel, ale od początku dobrze jest myśleć o danych trochę szerzej niż „wrzućmy JSON do bazy”. Zwłaszcza gdy planujesz produkty AI, gdzie każdy krok przetwarzania ma znaczenie.

Trzy proste zasady pomagają uniknąć chaosu:

- oddziel dane źródłowe od wyników modelu – surowy dokument (PDF, tekst, obraz) trzymasz w jednym miejscu, a wszystkie ekstrakty, klasyfikacje i streszczenia w drugim, z referencją do źródła,

- wersjonuj wyniki – gdy zmieniasz model, trzymaj informację, która wersja generowała dany wynik; inaczej nie odtworzysz, skąd wziął się błąd sprzed miesiąca,

- loguj kontekst – który użytkownik uruchomił zadanie, jakie parametry promptu zastosowano, z jakim statusem zakończył się proces.

Nawet jeśli na start robisz to w prostych tabelach w Postgresie, ten porządek zwróci się, gdy będziesz skalować z kilkudziesięciu do tysięcy dokumentów dziennie.

Łączenie danych z wielu systemów klienta

W polskich firmach dane rzadko żyją w jednym miejscu. Często masz trochę w ERP, trochę w CRM, część w mailach, a resztę w Excelach na dyskach działów. Model, który pracuje tylko na jednym źródle, widzi wycinek rzeczywistości.

Dlatego przed startem projektu przydaje się krótka „mapa danych” klienta:

- jakie systemy biorą udział w procesie,

- który z nich jest „źródłem prawdy” dla danej informacji (np. dane kontrahenta, status zamówienia),

- gdzie najlepiej wpiąć się z integracją – często wygodniej czytać dane z jednego, centralnego systemu niż z trzech peryferyjnych.

AI bywa dobrym pretekstem, żeby w ogóle uporządkować przepływ informacji w firmie. Nieraz okazuje się, że prosty webhook i jedna nowa tabela w CRM dają więcej niż rozbudowana integracja z pięcioma systemami na raz.

Strategia danych a model biznesowy

Dane nie są tylko kosztem i problemem prawnym – mogą stać się ważnym elementem przewagi konkurencyjnej. Żeby tak się stało, trzeba świadomie odpowiedzieć na kilka pytań.

Po pierwsze: czy dane klienta zostają wyłącznie jego własnością, a ty świadczysz jedynie usługę przetwarzania, czy też (za zgodą) budujesz na nich zagregowane modele dla wielu klientów? W Polsce coraz częściej wybierany jest model: „twoje dane pozostają tylko twoje, ale uczymy globalny model na zanonimizowanych, wspólnych wzorcach”. Warunek – pełna przejrzystość i możliwość opt‑out.

Po drugie: czy tworzysz własne, niezależne zbiory, np. z danych publicznych lub syntetycznych, które później staną się aktywem spółki? To może być niszowa baza wzorów umów branżowych, klasyfikacja rodzajów spraw sądowych czy typów incydentów w fabrykach.

Po trzecie: jak komunikujesz klientom „wartość danych”. Jeśli klient rozumie, że im dłużej korzysta z systemu, tym lepiej dopasowane wyniki otrzymuje (bo model uczy się na jego przypadkach), chętniej inwestuje czas w poprawną konfigurację i feedback.

Iteracyjne ulepszanie danych razem z produktem

Modele się starzeją, dane się zmieniają, procesy klienta też. To normalne, że po roku część pierwotnego datasetu przestaje pasować do aktualnej rzeczywistości biznesowej. Zamiast co jakiś czas „wrzucać nowy model na produkcję”, lepiej zaplanować ciągłą pielęgnację danych.

Pomaga prosty mechanizm:

- z każdego tygodnia lub miesiąca wyciągasz próbkę najnowszych przypadków,

- ktoś z biznesu ocenia, czy schemat etykiet nadal odpowiada realnym potrzebom,

- model jest okresowo douczany na najbardziej aktualnych danych, przy zachowaniu próbek historycznych dla stabilności,

- co jakiś czas wyrzucasz z datasetu stare, już niereprezentatywne przykłady (np. z nieistniejącego systemu lub procesu).

To bardziej ogród niż magazyn: bez regularnego przycinania i dosadzania nowych roślin szybko zamieni się w zarośla, w których model – i zespół – zaczyna się gubić.

Na co patrzą inwestorzy, gdy pytają o dane

Podczas rozmów z funduszem rzadko pada pytanie: „ile macie GPU?”. Znacznie częściej: „jakie macie dane i jak trudno byłoby je skopiować konkurencji?”. W polskich realiach AI przekonują głównie trzy elementy związane z danymi:

- dostęp do niszowych lub trudnych danych – np. specyficzne dokumenty, logi z maszyn, dane procesowe z danej branży,

- formalnie poukładane relacje – umowy z kluczowymi klientami, jasne zgody na uczenie modeli, opisane procesy anonimizacji,

- know‑how w przetwarzaniu – nie tylko „mamy dane”, ale „wiemy, jak z nich wydobywać powtarzalną wartość” (pipeline’y, etykietowanie, monitoring jakości).

Nawet jeśli zbiór nie jest ogromny, pokazanie, że jest sensownie zorganizowany, zabezpieczony i stale rośnie wraz z adopcją produktu, budzi zaufanie znacznie bardziej niż slajd z nazwami nowych modeli.

Najczęściej zadawane pytania (FAQ)

Czy w 2024/2025 roku w Polsce w ogóle opłaca się zakładać startup AI?

Tak, pod warunkiem że nie kopiujesz ogólnych narzędzi typu „kolejny generator tekstu”. Największa szansa leży dziś w wąskich, konkretnych zastosowaniach: automatyzacja procesów w firmach, rozwiązania dla danej branży, narzędzia mocno osadzone w języku polskim i lokalnych realiach.

Technologia stała się tańsza i łatwiej dostępna – nie potrzebujesz własnej serwerowni ani zespołu naukowców. Mały zespół jest w stanie w kilka tygodni zbudować sensowne MVP, korzystając z gotowych modeli, chmury i narzędzi no-code. Kluczowe jest jednak to, żebyś rozwiązywał realny, bolesny problem, a nie „robił coś z AI, bo jest moda”.

W jakich branżach w Polsce jest jeszcze „zielone pole” na startup AI?

Najszybciej rosną te segmenty, w których firmy mają dużo ręcznej pracy i spóźnioną cyfryzację. W polskich realiach szczególnie perspektywiczne są:

- produkcja i przemysł – np. predykcja awarii maszyn, kontrola jakości na podstawie obrazu, optymalizacja zużycia energii,

- logistyka i transport – optymalizacja tras, automatyzacja dokumentów, planowanie załadunku,

- medycyna i zdrowie – analiza dokumentacji medycznej, wsparcie diagnostyki, odciążenie rejestracji i administracji,

- finanse i ubezpieczenia – scoring ryzyka, wykrywanie fraudów, automatyzacja back-office,

- automatyzacja biurowa i sektor publiczny – inteligentne przetwarzanie dokumentów, wniosków, obsługa obywateli chatbotami zgodnymi z przepisami.

W każdej z tych branż są procesy nudne, powtarzalne i drogie w skali roku. Jeżeli potrafisz je zamienić na prosty, działający produkt, w praktyce konkurujesz bardziej z Excelem i kopiuj-wklej niż z innymi startupami.

Jak znaleźć dobry pomysł na startup AI w Polsce, jeśli „nie mam wielkiej wizji”?

Zamiast polowania na „genialny pomysł”, lepiej zejść do ziemi i wejść w buty konkretnej osoby z branży. Zapytaj: które czynności w jej pracy są żmudne, ręczne, powtarzalne, oparte na tekście, liczbach lub obrazach? AI świetnie radzi sobie właśnie z takim materiałem – dokumenty, maile, zdjęcia, nagrania.

Pomysły wychodzą z rozmów: z kierownikami, specjalistami, team leaderami. Przyglądaj się ogłoszeniom o pracę (po obowiązkach widać ręczne procesy), narzekaniom na grupach branżowych czy w raportach sektorowych. Dobrym sygnałem jest sytuacja, w której ludzie od lat „łatali” proces Excelem i ręcznymi obejściami. Typowy przykład to kancelaria, gdzie asystenci przepisują dane z umów do systemu – codzienna, powtarzalna praca, idealna pod automatyzację AI.

Jak ocenić, czy mój pomysł na startup AI ma sens biznesowy, a nie tylko technologiczny?

Pomaga prosta „matryca 4 pytań”. Sprawdź dla swojego pomysłu:

- Częstotliwość problemu – czy klient spotyka się z nim codziennie, raz w tygodniu, raz w roku?

- Intensywność bólu – ile ten problem kosztuje czasu, nerwów i pieniędzy; czy menedżerowie widzą go w raportach?

- Gotowość do zapłaty – czy firma już teraz płaci za „łatki” (nadgodziny, konsultantów, inne narzędzia)?

- Dojrzałość danych – czy potrzebne dane w ogóle istnieją i są dostępne w systemach, plikach, bazach?

Jeżeli problem jest częsty, bolesny i firma już coś z nim robi (czyli płaci), a dane są przynajmniej częściowo dostępne, masz dużo lepszy punkt startu niż przy „efektownym” zastosowaniu AI do rzadkich sytuacji. Startup wygrywa często nie technologicznie, tylko tym, że rozwiązuje nudny, ale kosztowny kłopot tysiąca firm.

Jak rozmawiać z pierwszymi klientami, zanim zacznę budować MVP AI?

Na początku lepiej odłożyć slajdy i dema. Usiądź z 10–20 osobami z docelowej grupy i poproś, żeby opowiedziały, jak wygląda ich dzień pracy – krok po kroku. Dopytuj, gdzie się zatrzymują, gdzie robią kopiuj-wklej, co ich najbardziej frustruje. Nie sprzedawaj jeszcze „rozwiązania AI”, tylko drąż problem.

Pomagają pytania typu: „Co zajmuje ci najwięcej czasu, a nie wnosi realnej wartości?”, „Jakie zadania najczęściej odkładasz na później?”, „Gdybyś miał podwoić liczbę klientów bez zwiększania zespołu, co by się pierwsze wyłożyło?”. Po kilku takich rozmowach zobaczysz powtarzające się wzorce i lepiej zaprojektujesz MVP, które faktycznie trafi w sedno.

Jakie są główne plusy i minusy budowania startupu AI akurat w Polsce?

Po stronie plusów: stosunkowo niskie koszty zespołu przy wysokich kompetencjach technicznych oraz łatwy dostęp do rynku UE – możesz sprzedawać do Niemiec czy Holandii, operując z Polski. Dochodzą do tego granty i wsparcie publiczne (NCBR, PARP, programy regionalne, akceleratory), które potrafią sfinansować część badań, rozwoju, prototypu czy wyjścia za granicę.

Minusy są równie konkretne. Polski rynek, szczególnie B2C, jest mały, więc od początku trzeba myśleć o skalowaniu poza kraj. Konkurencja zagraniczna może wejść z podobnym rozwiązaniem szybciej i z większym budżetem. Dochodzi wymagające otoczenie regulacyjne: AI Act, RODO, przepisy sektorowe w medycynie czy finansach. Z drugiej strony, jeśli od startu projektujesz produkt pod te regulacje, stają się one murem, który utrudni wejście gorzej przygotowanej konkurencji.

Skąd wziąć finansowanie na pierwszy MVP AI w Polsce – inwestor, grant, własne środki?

Najczęstszy scenariusz to miks środków własnych i zewnętrznych. Dzięki tanim modelom i chmurze da się zbudować pierwsze MVP w małym zespole bez milionowych inwestycji. W praktyce wiele zespołów zaczyna od prostego pilota z kilkoma klientami, finansowanego z oszczędności albo zleceń usługowych „obok”.

Równolegle można szukać wsparcia publicznego: programy NCBR, PARP, fundusze regionalne, akceleratory. Często nie pokryją całości biznesu, ale pomogą sfinansować prace badawczo-rozwojowe czy ekspansję. Inwestor prywatny (VC, anioł biznesu) zwykle wchodzi chętniej, gdy już masz działające MVP, pierwszych użytkowników i dowód, że rozwiązujesz konkretny, mierzalny problem, a nie jedynie ciekawie korzystasz z AI.

Opracowano na podstawie

- Artificial Intelligence Act – political agreement and main elements. European Commission (2023) – Informacje o założeniach i zakresie regulacji AI Act w UE

- Regulation (EU) 2016/679 General Data Protection Regulation. European Union (2016) – Podstawa prawna RODO, zasady przetwarzania danych osobowych w UE

- AI Index Report. Stanford Institute for Human-Centered Artificial Intelligence (2024) – Globalne trendy w AI, inwestycje, zastosowania sektorowe

- Artificial Intelligence and the Future of Work. OECD (2019) – Wpływ AI na produktywność, strukturę pracy i kompetencje

- The State of AI in 2023. McKinsey & Company (2023) – Raport o adopcji AI w firmach, obszarach zastosowań i ROI

- AI in Europe: Investment, adoption and the role of policy. European Investment Bank (2022) – Inwestycje i wdrożenia AI w Europie, różnice regionalne

- Poland – Country Digital Readiness Assessment. World Bank (2020) – Ocena gotowości cyfrowej Polski, infrastruktura, kompetencje, innowacje

- Sztuczna inteligencja w Polsce – raport. Ośrodek Przetwarzania Informacji – Państwowy Instytut Badawczy (2020) – Przegląd ekosystemu AI w Polsce, firmy, badania, regulacje